只需一张图片、一句动作指令,Animate124轻松生成3D视频

近一年来,DreamFusion 引领了一个新潮流,即 3D 静态物体与场景的生成,这在生成技术领域引发了广泛关注。回顾过去一年,我们见证了 3D 静态生成技术在质量和控制性方面的显著进步。技术发展从基于文本的生成起步,逐渐融入单视角图像,进而发展到整合多种控制信号。

与此相较,3D 动态场景生成仍处于起步阶段。2023 年初,Meta 推出了 MAV3D,标志着首次尝试基于文本生成 3D 视频。然而,受限于开源视频生成模型的缺乏,这一领域的进展相对缓慢。

然而,现在,基于图文结合的 3D 视频生成技术已经问世!

尽管基于文本的 3D 视频生成能够产生多样化的内容,但在控制物体的细节和姿态方面仍有局限。在 3D 静态生成领域,使用单张图片作为输入已经能够有效重建 3D 物体。由此受到启发,来自新加坡国立大学(NUS)和华为的研究团队提出了 Animate124 模型。该模型结合单张图片和相应的动作描述,实现了对 3D 视频生成的精准控制。

- 项目主页: https://animate124.github.io/

- 论文地址: https://arxiv.org/abs/2311.14603

- Code: https://github.com/HeliosZhao/Animate124

核心方法

方法概括

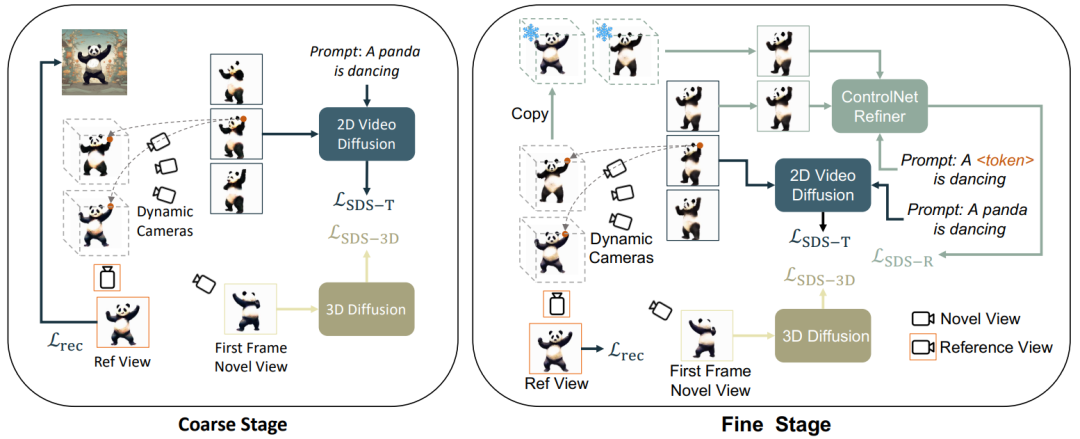

根据静态和动态,粗糙和精细优化,本文将 3D 视频生成分为了 3 个阶段:1)静态生成阶段:使用文生图和 3D 图生图扩散模型,从单张图像生成 3D 物体;2)动态粗糙生成阶段:使用文生视频模型,根据语言描述优化动作;3) 语义优化阶段:额外使用个性化微调的 ControlNet,对第二阶段语言描述对外观造成的偏移进行优化改善。

图 1. 整体框架

静态生成

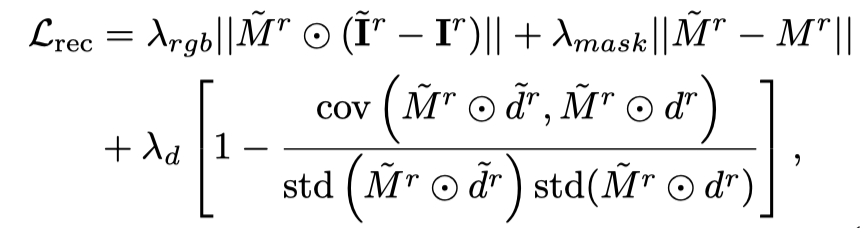

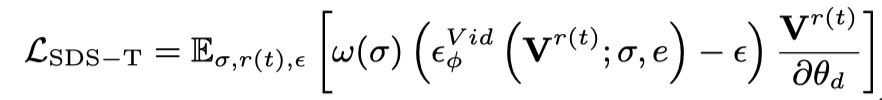

本文延续 Magic123 的方法,使用文生图(Stable Diffusion)和 3D 图生图(Zero-1-to-3)进行基于图片的静态物体生成:

对于条件图片所对应的视角,额外使用损失函数进行优化:

通过上述两个优化目标,得到多视角 3D 一致的静态物体(此阶段在框架图中省略)。

动态粗糙生成

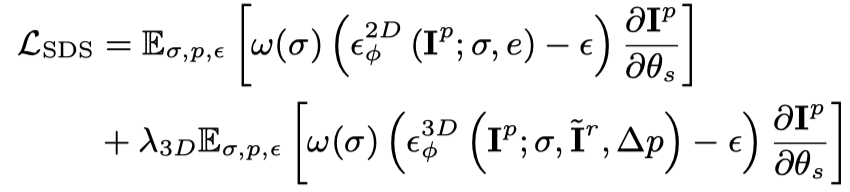

此阶段主要使用文生视频扩散模型,将静态 3D 视为初始帧,根据语言描述生成动作。具体来说,动态 3D 模型(dynamic NeRF)渲染连续时间戳的多帧视频,并将此视频输入文生视频扩散模型,采用 SDS 蒸馏损失对动态 3D 模型进行优化:

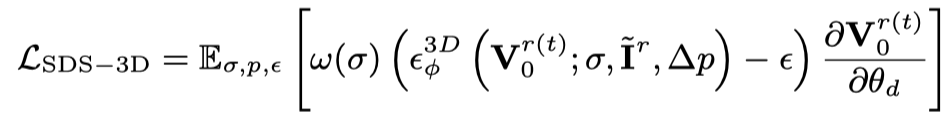

仅使用文生视频的蒸馏损失会导致 3D 模型遗忘图片的内容,并且随机采样会导致视频的初始和结束阶段训练不充分。因此,本文的研究者们对开始和结束的时间戳进行过采样。并且,在采样初始帧时,额外使用静态函数进行优化(3D 图生图的 SDS 蒸馏损失):

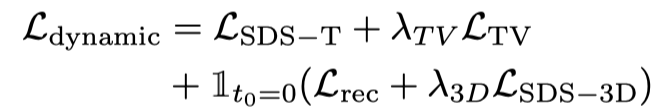

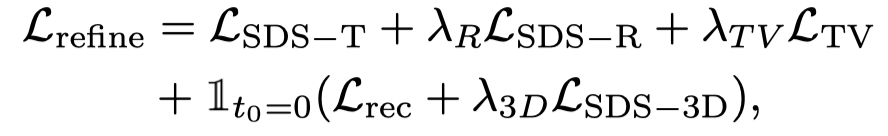

因此,此阶段的损失函数为:

语义优化

即使采用了初始帧过采样并且对其额外监督,在使用文生视频扩散模型的优化过程中,物体的外观仍然会受到文本的影响,从而偏移参考图片。因此,本文提出了语义优化阶段,通过个性化模型对语义偏移进行改善。

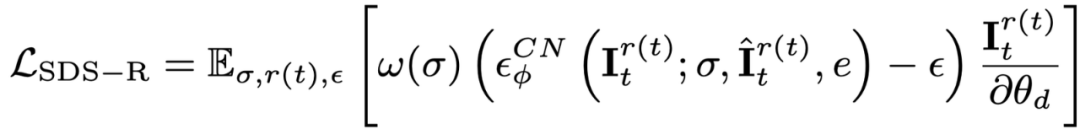

由于仅有单张图片,无法对文生视频模型进行个性化训练,本文引入了基于图文的扩散模型,并对此扩散模型进行个性化微调。此扩散模型应不改变原有视频的内容和动作,仅对外观进行调整。因此,本文采用 ControlNet-Tile 图文模型,使用上一阶段生成的视频帧作为条件,根据语言进行优化。ControlNet 基于 Stable Diffusion 模型,只需要对 Stable Diffusion 进行个性化微调(Textual Inversion),即可提取参考图像中的语义信息。个性化微调之后,将视频视为多帧图像,使用 ControlNet 对单个图像进行监督:

另外,因为 ControlNet 使用粗糙的图片作为条件,classifier-free guidance (CFG) 可以使用正常范围(10 左右),而不用与文生图以及文生视频模型一样使用极大的数值(通常是 100)。过大的 CFG 会导致图像过饱和,因此,使用 ControlNet 扩散模型可以缓解过饱和现象,实现更优的生成结果。此阶段的监督由动态阶段的损失和 ControlNet 监督联合而成:

实验结果

作为第一个基于图文的 3D 视频生成模型,本文与两个 baseline 模型和 MAV3D 进行了比较。与其他方法相比,Animate124 有更好的效果。

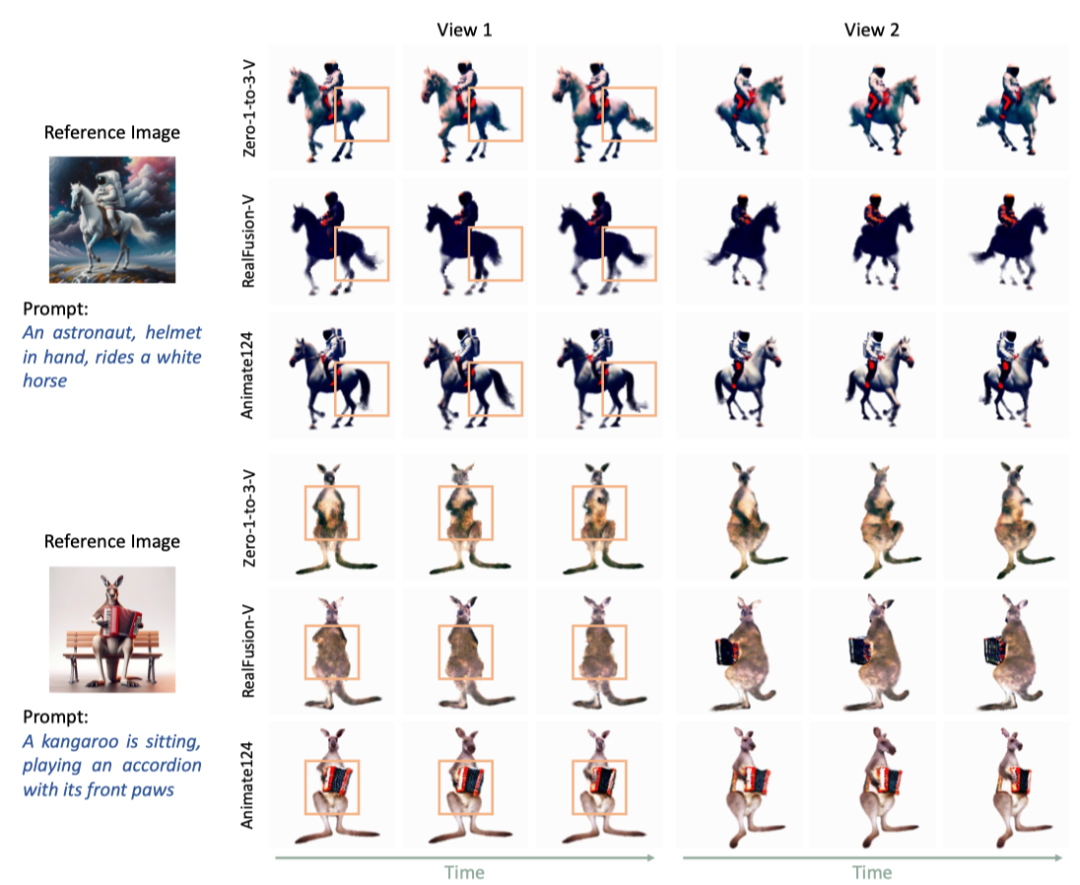

可视化结果比较

图 2. Animate124 与两个 baseline 比较

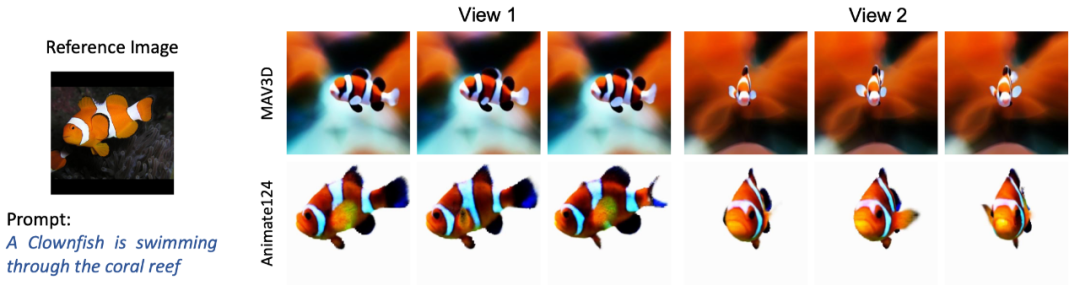

图 3.1. Animate124 与 MAV3D 文生 3D 视频比较

图 3.1. Animate124 与 MAV3D 图生 3D 视频比较

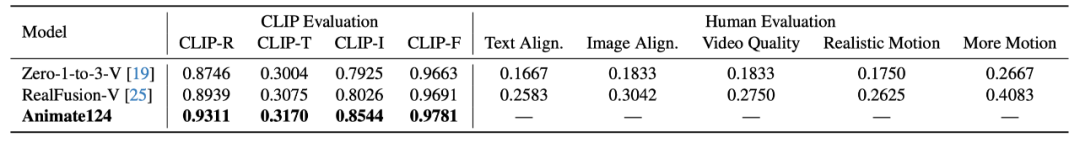

量化结果比较

本文使用 CLIP 和人工评价生成的质量,CLIP 指标包括与文本的相似度和检索准确率,与图片的相似度,以及时域一致性。人工评价指标包括与文本的相似度,与图片的相似度,视频质量,动作真实程度以及动作幅度。人工评价表现为单个模型与 Animate124 在对应指标上选择的比例。

与两个 baseline 模型相比,Animate124 在 CLIP 和人工评价上均取得更好的效果。

表 1. Animate124 与两个 baseline 量化比较

总结

Animate124 是首个根据文本描述,将任意图片变成 3D 视频的方法。其采用多种扩散模型进行监督和引导,优化 4D 动态表征网络,从而生成高质量 3D 视频。